好文推荐|基于牛顿物理增强神经网络的视觉点时空预测

2024-12-17

2024-12-17

6979

6979

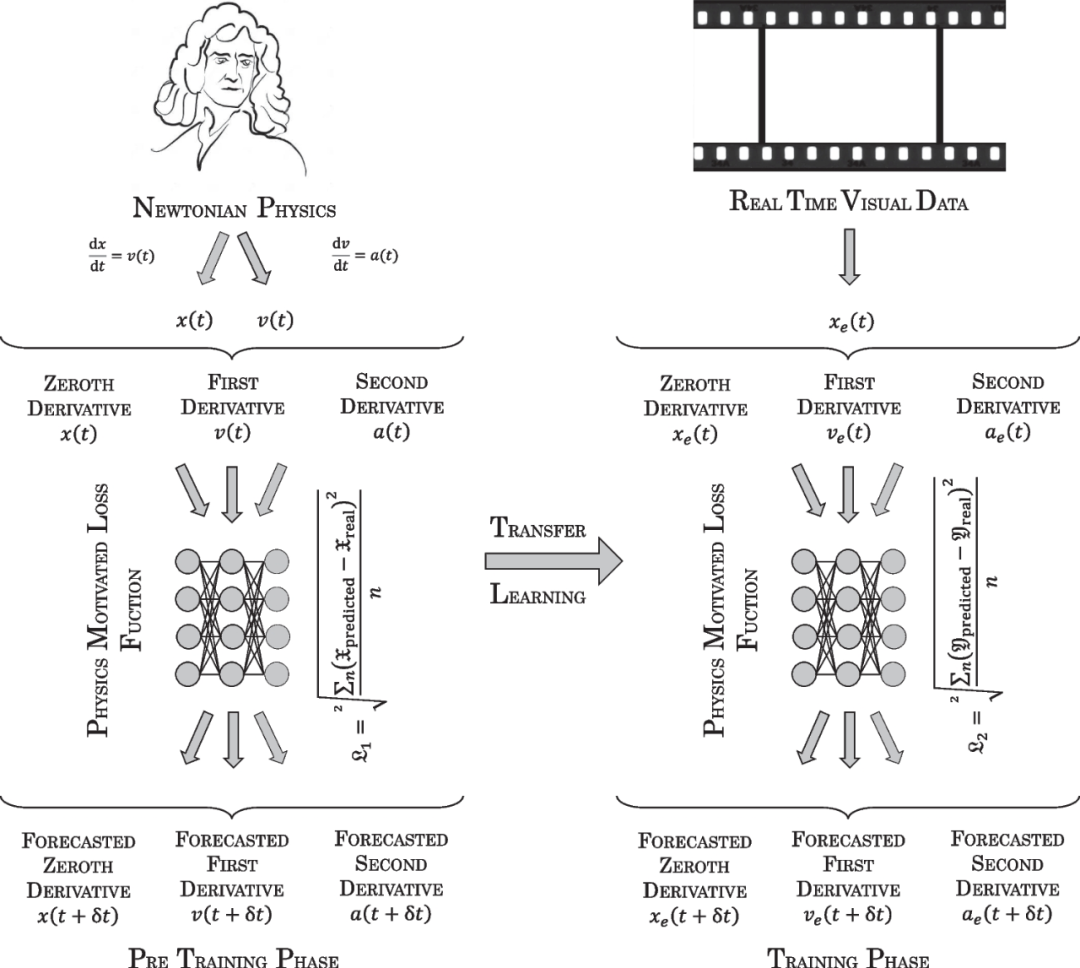

近日,一篇由印度Government College of Engineering and Textile Technology、Bajaj Institute of Technology and Management、Velammal Engineering College和科威特American School of Education等机构学者合作的论文“Newtonian Physics Informed Neural Network (NwPiNN) for Spatio-Temporal Forecast of Visual Data”(译:基于牛顿物理增强神经网络的视觉点时空预测)在国际期刊《以人为中心的智能系统(英文)》(Human-Centric Intelligent Systems, HCIN, eISSN: 2667-1336)上公开发表(DOI:https://doi.org/10.1007/s44230-024-00071-5)。 ▲ 图1 牛顿物理增强神经网络(NwPiNN)的框架图。 一句话概要: 牛顿定律引导神经网络建模运动速度和加速度,提升图像序列的时空预测精度。 研究动机: 时间序列是一个非静态集合的专业术语,集合的数据点之间具有时间维度上的连续性。时间序列预测是指通过统计手段或智能算法来预测未来的数据点。传统方法以统计学为主,常见的模型包括自回归差分移动平均模型(ARIMA)和指数平滑法(SES)。随着机器智能的兴起,以LSTM为代表的时间序列预测模型在工程、医疗、司法等领域被广泛使用。 与大多数工作聚焦于数值点时间序列不同,该工作围绕视觉点,基于历史图像序列不同帧之间的关系来预测下一帧图像。时间序列预测的研究主要关注预测的时间步长和计算效率问题。传统LSTM模型难以预测长序列,而后续提出的Transformer模型虽然可以解决长序列问题,但计算效率较低。最新的研究工作分别从轻量化、可解释、损失设计等不同角度进行了优化。考虑到像素灰度值的预测会受速度和加速度的影响,该工作引入了牛顿定律来优化神经网络模型。 研究方法与发现: 本文提出了一种牛顿物理增强的神经网络(NwPiNN)。该网络采用LSTM作为基本骨架,计算像素灰度值的零阶、一阶和二阶导数,通过如下公式将计算的运动学特征加权融合: 得出下一帧图像的预测结果。最后,计算预测值和真实值的RMSE损失,训练网络模型。 通过小球在坚硬和弹性表面分别进行弹跳试验,人工合成了两种视觉数据集。提出的NwPiNN方法在合成数据集上与ConvLSTM和CNN-LSTM等现有模型进行了全面对比。结果发现,NwPiNN方法的预测精度在大多数情况下优于ConvLSTM和CNN-LSTM方法,NwPiNN能够更好地捕捉视觉点时间序列中的动态变化。 研究贡献: 1)该工作聚焦于视觉点时间序列预测,是对经典数值点时间序列预测的进一步延伸与扩展; 2)引入了牛顿物理定律,增强了模型建模像素灰度值变化速度和加速度的能力,降低了预测误差。 (编辑:胡开喜) 关于期刊 Human-Centric Intelligent Systems(eISSN:2667-1336)是一本国际化的,经过严格同行评审的开放获取期刊,致力于传播 “以人为中心的智能系统” 中所有相关理论和实际应用的最新研究成果,并提供以人为中心的计算与分析领域的前沿理论和算法见解。为了鼓励科研成果的传播,本刊暂不收取文章处理费。 期刊主编:西南交通大学李天瑞教授与澳大利亚悉尼科技大学徐贯东教授 顾问委员:东京大学教授,日本国家信息研究所所长Masaru Kitsuregawa与伊利诺伊大学芝加哥分校Philip S. Yu教授 投稿咨询: HCIN期刊编辑部 Tel:17320182488 邮箱:hcin@editorialoffice.cn